Les CAPTCHA (Completely Automated Public Turing test to tell Computers and Humans Apart), tests consistant à cliquer sur des images ou résoudre des puzzles pour prouver son humanité afin d'accéder à une page web, deviennent de plus en plus complexes.

Cette méthode a d'abord été introduite au début des années 2000 dans le but d'empêcher les robots de se faire passer pour des utilisateurs humains et d'effectuer des actions automatiques, comme la création de comptes ou la soumission de formulaires. À l'origine, ces tests impliquaient de deviner des mots aux lettres déformées et de les saisir, une tâche relativement simple pour un humain, mais très difficile pour un programme informatique.

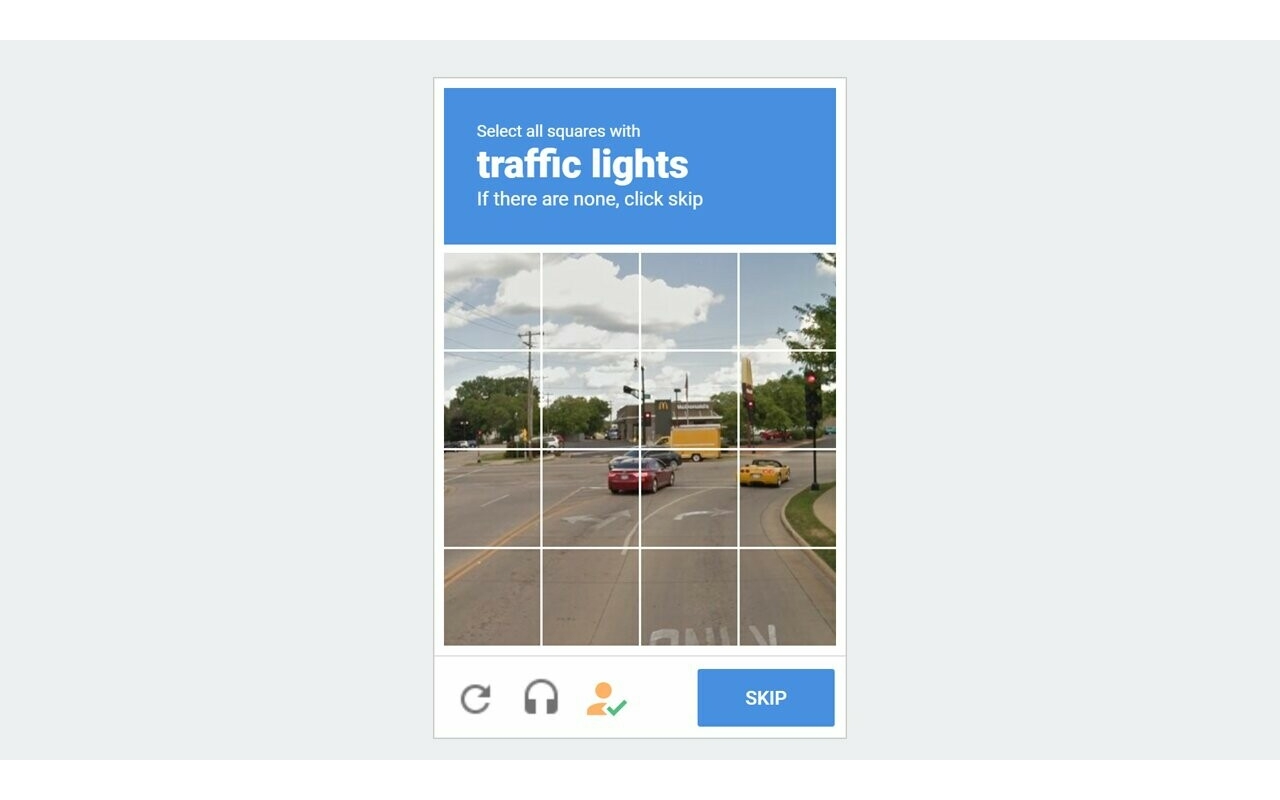

Cependant, cette stratégie n'a été efficace que temporairement, car les robots ont rapidement progressé. Au fil des années, les CAPTCHA sont devenus plus complexes, demandant par exemple de repérer des éléments précis comme des feux de circulation, des bus ou des passages piétons. Mais même cette évolution a été suivie par les robots, rendant les CAPTCHA parfois très étranges.

Désormais, des tâches telles que « choisir deux objets de la même forme », « cliquer sur un élément qui ne peut pas vivre sous l'eau », ou encore « faire correspondre le nombre de cailloux à un chiffre » deviennent de plus en plus courantes pour décourager les robots. Il ne suffit plus de simplement reconnaître un élément, il faut maintenant l'associer à une autre idée, le comparer et l'analyser, rendant la tâche des robots extrêmement difficile. En ajoutant des images générées par l'intelligence artificielle, cette difficulté est encore accentuée.

Cependant, à mesure que de nouvelles idées sont introduites pour contrer les robots, ceux-ci continueront toujours à s'adapter. L'objectif n'est donc pas tant de bloquer totalement les robots, mais plutôt de rendre la résolution des CAPTCHA si longue et coûteuse que cela ne vaudra pas la peine pour eux. Cette stratégie vise donc à ralentir les actes cybercriminels en rendant leur exécution moins rentable.